第1章でAIとは何か、どんな歴史を経て現在に至るかを大きな流れで押さえました。第2章は、その歴史の中で登場した3つのアプローチ——探索・推論、知識表現、機械学習・深層学習——の「中身」を学ぶ章です。

第1章と第2章は表裏の関係にあります。

| 第1章(歴史) | 第2章(技術の中身) |

|---|---|

| 第1次ブーム:探索・推論の時代 | 2-1:探索・推論の仕組み |

| 第2次ブーム:知識の時代 | 2-2:知識表現の方法論 |

| 第3次ブーム:機械学習・特徴表現学習の時代 | 2-3:機械学習・ディープラーニングの仕組み |

「なぜその技術が生まれたか(第1章)」と「その技術がどう動くか(第2章)」をセットで理解することが、Part 1 の学習ゴールです。

第2章の全体像

第2章は、白本(公式テキスト)の構成に沿って、次の3節で構成されています。

| 節 | タイトル | 扱う内容 |

|---|---|---|

| 2-1 | 探索・推論 | 探索木・幅優先・深さ優先・ヒューリスティック・ゲームへの応用(Mini-Max法・αβ法・モンテカルロ法) |

| 2-2 | 知識表現 | 人工無脳・意味ネットワーク・オントロジー・エキスパートシステム・知識獲得のボトルネック |

| 2-3 | 機械学習・深層学習 | 機械学習の仕組み・ニューラルネットワークの歴史・ディープラーニングの台頭・大規模言語モデル |

この章を一言でまとめると、「AIを賢くするための3つのアプローチが、それぞれどう動き、どこで行き詰まったか」を技術的に理解する章です。

2-1|探索・推論

「探索」とは何か

探索とは、ゴールにたどり着くまでの経路を場合分けで洗い出す方法です。迷路を解くとき、コンピュータは「ここを曲がる・曲がらない」という選択肢を木の枝のように広げながら、正解の経路を見つけていきます。このような構造を探索木(ツリー構造)と呼びます。

基本的な探索方法は2つです。

| 手法 | 進め方 | 特徴 |

|---|---|---|

| 幅優先探索 | 出発点に近いノードから順に探索する | 最短経路を必ず見つけられる。ただし、複雑になるとメモリを大量に消費する。 |

| 深さ優先探索 | 行き止まりまで進んでから戻って探索する | メモリ消費は少ない。ただし、見つかった解が最短とは限らない。 |

探索を効率化するためにヒューリスティックな知識(経験的・発見的な知識)を使う方法もあります。たとえば「東京から大阪へ行くとき、関係のない北の経路は最初から除外する」というように、コストのかかる探索を省略できます。

ゲームへの応用

チェスや囲碁のようなボードゲームでは、相手が存在するため単純な探索では対応できません。そこで登場するのがMini-Max法です。

考え方はシンプルです。自分の番では自分が有利(スコア最大)になる手を選び、相手の番では相手が有利(自分のスコア最小)になる手を相手が選ぶと仮定して、未来の局面から現在に向かって逆算しながら最善手を決定します。

Mini-Max法は論理的に無駄な探索が生じるため、計算不要な枝を切り落とすαβ法(アルファベータ法)という改良版も重要な手法です。

さらに、囲碁のように組み合わせが膨大すぎて全探索が不可能な場合には、ランダムなシミュレーションを大量に繰り返して統計的に最善手を近似するモンテカルロ法(モンテカルロ木探索)が使われます。AlphaGoが登場する以前、囲碁AIを強化した主要技術のひとつです。

試験では、「どのゲームにどの手法が対応するか」と「各手法の限界(計算量爆発)」が問われることがあります。

2-2|知識表現

人工無脳——知識なしでも「賢く見える」不思議

1964〜1966年に開発されたイライザ(ELIZA)は、人工無脳の元祖です。相手の発言をあらかじめ用意したパターンと照合し、パターンに合致した返答を返すだけの仕組みですが、本物の人間と対話しているような錯覚(イライザ効果)が生まれました。

これは「意味を理解せずに適切に見える応答ができる」という現象であり、第1章の「中国語の部屋」と同じ構造を持っています。

意味ネットワーク

「概念」をノードで、「概念間の関係」をリンク(矢印)で結んだネットワーク構造で知識を表現する方法です。

特に重要な関係が2つあります。

| 関係 | 意味 | 例 |

|---|---|---|

| is-a(継承関係) | 「〇〇はXXである」という上位・下位の関係。推移律が成立する。 | 「犬は哺乳類である」「哺乳類は動物である」→「犬は動物である」が自動的に導ける |

| part-of(属性関係) | 「〇〇はXXの一部である」という関係 | 「足は犬の一部である」「肉球は足の一部である」 |

意味ネットワークは人間にとって直感的で分かりやすく、関連する知識をリンクをたどって検索できます。ただし、記述の約束事が決まっていないため、複数の人が知識を記述すると語彙や記述レベルがバラバラになり、共有が困難になります。

オントロジー

意味ネットワークの「記述の約束事がない」という問題を解決するのがオントロジーです。知識を記述する際の語彙・意味・関係性を、他の人とも共有できるように明確な約束事として定義したものです。

オントロジーが整備されていれば、複数のシステム間で知識を共有・連携させることが可能になります。

なお、「すべての常識をコンピュータに入れよう」という壮大な試みが1984年から始まったCycプロジェクトです。「パリはフランスの首都です」「すべての木は植物です」といった常識を延々と入力し続けるこのプロジェクトは、驚くべきことに現在も継続中です。人間の常識がいかに膨大で、形式化が難しいかを示す象徴的な事例です。

エキスパートシステムと知識獲得のボトルネック

第2次AIブームを牽引したエキスパートシステムは、専門家の知識をルール化してコンピュータに蓄積し、特定の分野で判断を下すシステムです。医療診断・化学分析など多くの分野で実用化されました。

しかし限界が明らかになります。専門家の持つ知識の多くは暗黙的で言語化が難しく、知識の数が数千・数万になると矛盾や管理の問題が生じました。さらに、一般常識のような「明文化されていない知識」はそもそも取り込むこと自体が困難でした。この問題を知識獲得のボトルネックと呼び、第2次ブームの終焉をもたらした主要因です。

2-3|機械学習・深層学習

機械学習——データからパターンを学ぶ

機械学習とは、AIのプログラム自身がデータから学習する仕組みです。コンピュータは大量のサンプルデータを通してデータに潜むパターンを学習します。サンプルデータが多ければ多いほど、望ましい学習結果が得られます。

機械学習において、学習対象の「どの特徴に注目するか」を定量的に表したものを特徴量と呼びます。機械学習では、この特徴量を人間が選んで設定し、AIがその特徴量からパターンを学習します。

データの特徴が増えすぎると、必要なデータ量が指数的に増大するという次元の呪いも重要な概念です。機能する学習を行うには、特徴量(次元)を絞る工夫か、大量の多様なデータが必要になります。

2000年以降、インターネットの普及でデータが爆発的に増加したことで機械学習は大きく実用化が進みました。この大量データをビッグデータと呼び、第3次AIブームの土台となりました。

ニューラルネットワークの歴史

ニューラルネットワークは、人間の脳の神経回路(ニューロン)の構造を模したアルゴリズムです。その歴史はAIブームと並行して3つのブームを経験してきました。

| ブーム | 時期 | できごと | 限界 |

|---|---|---|---|

| 第1次 | 1950〜60年代 | パーセプトロンの登場 | 線形分離不可能な問題に対応できないことが指摘され終焉 |

| 第2次 | 1980〜90年代 | 多層パーセプトロン・誤差逆伝播法の登場。LeNetの提案(ヤン・ルカン、1989年) | 計算コストの限界・サポートベクターマシンの台頭により終焉 |

| 第3次 | 2006年〜 | オートエンコーダ・活性化関数の工夫で多層化に成功。データ量とハードウェア向上でディープラーニングが本格始動 | (現在進行形) |

特徴量を人間が決める機械学習(レベル3)に対して、特徴量そのものもAIが自動学習する技術がディープラーニングです。この違いが、機械学習とディープラーニングを区別する核心です。

ディープラーニングの台頭

2012年、画像認識競技会ILSVRC(ImageNet Large Scale Visual Recognition Challenge)でトロント大学のジェフリー・ヒントンが率いるチーム「SuperVision」がディープラーニングを用いて圧倒的な勝利を収めました。2015年には人間の画像認識エラー率(約4%)をも上回る精度を達成しています。

2016年には、DeepMindが開発したAlphaGoが世界トップの囲碁棋士イ・セドル九段に勝利。これはモンテカルロ木探索にディープラーニングを組み合わせた成果です。

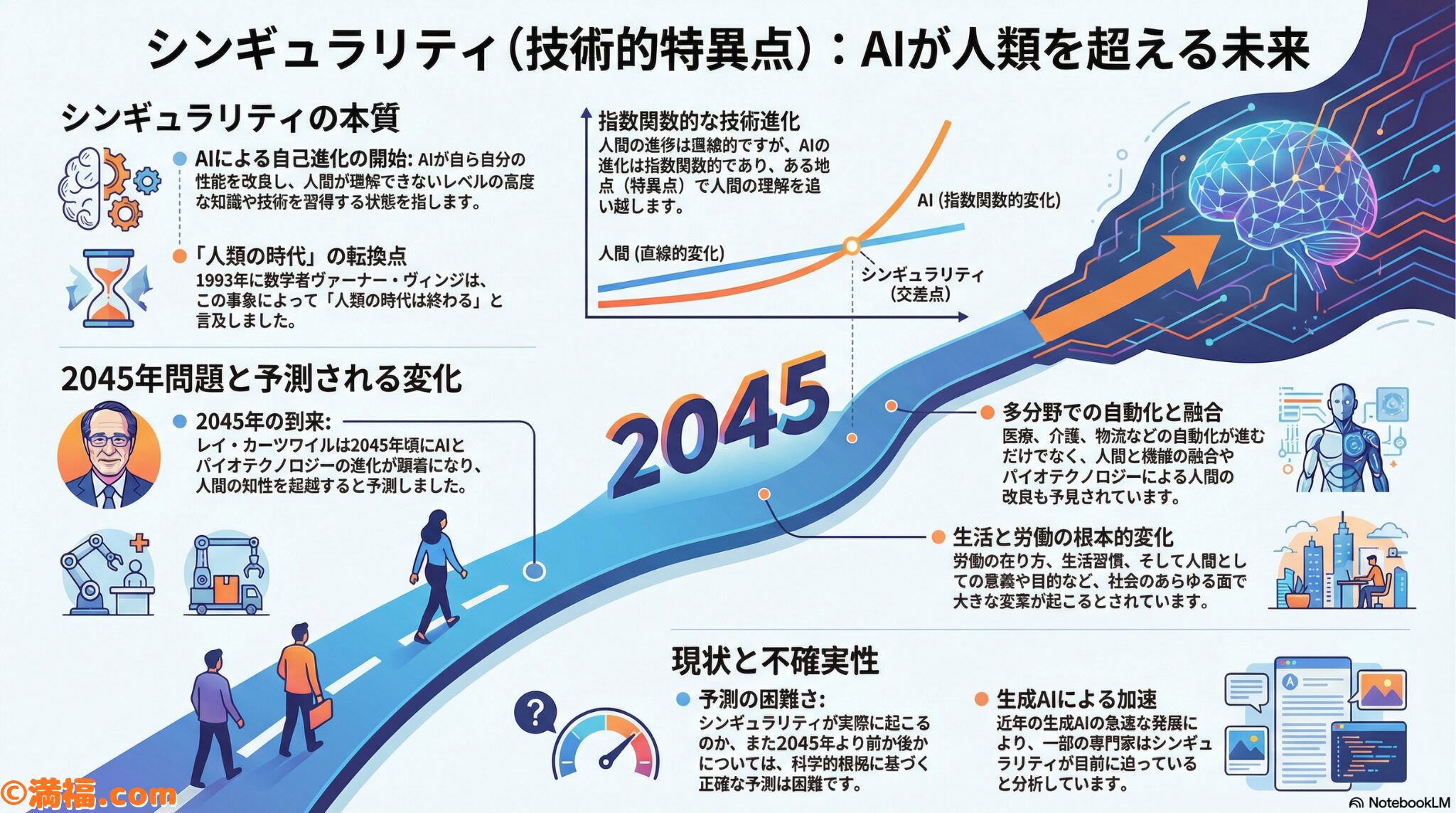

これらの出来事は、人間を超える「超知性」の誕生(シンギュラリティー)への関心を世界規模で高めました。

大規模言語モデル(LLM)と生成AI

2017年、Googleの研究者が発表した論文「Attention Is All You Need」で提案されたトランスフォーマーが、自然言語処理の世界を一変させました。単語と単語の関係性を「アテンション(注意機構)」を使って広範囲にわたって学習できるこのモデルは、従来のRNNが苦手としていた長距離の文脈理解と並列計算を可能にしました。

トランスフォーマーをベースに、大量のテキストデータで事前学習させた巨大なニューラルネットワークを大規模言語モデル(LLM: Large Language Model)と呼びます。

LLMの開発では、まず大量の文章で基本的な言語構造を学ぶ事前学習を行い、次に特定のタスクや応用分野に向けたファインチューニング(微調整)を加えることで、論理的・適切な応答を生成できるようになります。

2022年11月にOpenAIが公開したChatGPTは、このLLMを活用したサービスで、公開後わずか2カ月でアクティブユーザー1億人を突破。「生成AI」という言葉を社会に広く浸透させ、第4次AIブームとも呼ばれる現在の局面を切り拓きました。

第2章のまとめ

第2章で理解しておくべきことを3行に絞るとこうなります。

- 探索・推論は「場合分けで解を見つける」技術。ゲームへの応用(Mini-Max法・モンテカルロ法)が試験頻出。

- 知識表現は「概念と関係を構造化する」技術。意味ネットワーク(is-a/part-of)とオントロジーの違いを押さえる。エキスパートシステムの限界が知識獲得のボトルネック。

- 機械学習・ディープラーニングは「データから自ら学ぶ」技術。特徴量を人が設定するか(機械学習)AIが自動学習するか(ディープラーニング)が核心の違い。

この3点が説明できれば、第2章の「枝」はつかめています。

🔑 試験対策キーワード

ここからは「葉」のフェーズです。Mainキーワードを10秒で説明できる状態を目指してください。Subは問題を解いていて「迷った・止まった」語句だけ追加していきます。

■ Main(説明の軸:必ず10秒で話せるようにする)

| キーワード | 10秒で言えること |

|---|---|

| 探索木(ツリー構造) | 場合分けを枝状に展開した構造。AIが解を探す際の基本的な仕組み。 |

| 幅優先探索 | 出発点に近いノードから順に探索する方法。最短経路を必ず見つけられるが、メモリを多く消費する。 |

| 深さ優先探索 | 行き止まりまで進んでから戻る方法。メモリは少なくて済むが、最短経路とは限らない。 |

| ヒューリスティックな知識 | 経験的・発見的な知識。探索を効率化するために、コストのかかる経路を事前に除外するために使う。 |

| Mini-Max法 | 自分の番ではスコア最大、相手の番ではスコア最小を選ぶ仮定で未来から逆算して最善手を決めるゲーム戦略。 |

| αβ法(アルファベータ法) | Mini-Max法の改良版。計算不要な枝を切り落として探索を効率化する手法。 |

| モンテカルロ法(モンテカルロ木探索) | ランダムなシミュレーションを大量に繰り返して統計的に最善手を近似する探索手法。囲碁AIに有効。 |

| 意味ネットワーク | 概念をノード、概念間の関係をリンク(矢印)で結んだ知識表現の方法。 |

| is-a関係 | 「犬は哺乳類である」のような上位・下位の継承関係。推移律が成立する。 |

| part-of関係 | 「足は犬の一部である」のような属性関係。 |

| オントロジー | 知識を記述する語彙・意味・関係性を、共有できるように明確な約束事として定義したもの。知識の共有と再利用を可能にする。 |

| エキスパートシステム | 専門家の知識をルール化してデータベースに蓄積し、特定分野で判断を下すシステム。第2次AIブームの中心技術。 |

| 特徴量 | 機械学習において、学習対象の「どの特徴に注目するか」を定量的に表したもの。機械学習では人間が設定し、ディープラーニングではAIが自動学習する。 |

| 次元の呪い | データの特徴(次元)が増えると、適切な学習に必要なデータ量が指数的に増大する現象。 |

| ニューラルネットワーク | 人間の脳の神経回路を模したアルゴリズム。パーセプトロンを層状に重ねた構造。 |

| トランスフォーマー | 2017年にGoogleが提案した、アテンション機構を使って単語と単語の関係性を広範囲に学習できるモデル。現在のLLM・生成AIの基盤技術。 |

| 大規模言語モデル(LLM) | 大量のテキストデータで事前学習した巨大なニューラルネットワーク。ChatGPTはLLMを活用したサービス。 |

| 事前学習 | LLMが大量の文章から言語の基本構造を学ぶ最初の学習フェーズ。 |

| ファインチューニング | 事前学習済みのモデルを、特定のタスクや分野に向けて微調整する学習。 |

■ Sub(補助説明:問題で迷ったら追加する)

| キーワード | 一言で言えること |

|---|---|

| イライザ(ELIZA)・人工無脳 | パターン照合で返答するだけなのに、本物の人間と話しているような錯覚(イライザ効果)を生む。意味理解なしに「賢く見える」典型例。 |

| Cycプロジェクト | 1984年から常識をすべてコンピュータに入力しようとしている現在も継続中のプロジェクト。常識の膨大さと形式化の難しさを示す。 |

| パーセプトロン | ニューラルネットワークの最小単位。複数の入力を受け取り1つの値を出力する。 |

| 誤差逆伝播法 | ニューラルネットワークの出力の誤差を逆方向に伝えながら重みを調整する学習方法。多層パーセプトロンの学習を可能にした。 |

| AlphaGo | DeepMindが開発した囲碁AI。2016年に世界トップ棋士に勝利。モンテカルロ木探索とディープラーニングを組み合わせた。 |

| シンギュラリティー | AIが人間の知能を超える「超知性」が誕生する時点。AlphaGoの勝利などを機に議論が活発化。 |

| アテンション(注意機構) | 文中の単語と単語の関係性を広範囲に計算する仕組み。トランスフォーマーの核心技術。 |

| ChatGPT | OpenAIが2022年に公開したLLMを活用した対話サービス。公開後2カ月で1億ユーザーを突破し生成AIを社会に広めた。 |

■ Reference(読めば分かる:覚えなくてよい)

| キーワード |

|---|

| ILSVRC(2012年にディープラーニングが圧勝した画像認識競技会) |

| LeNet(1989年、ヤン・ルカンが提案した畳み込みニューラルネットワーク。画像認識の基礎) |

| サポートベクターマシン(第2次ニューラルネットワークブームを終わらせた機械学習手法) |

| ジェフリー・ヒントン(2012年のILSVRC優勝チームSuperVisionを率いた研究者) |

| GPT(OpenAIが開発したトランスフォーマーベースのLLM。ChatGPTの基盤) |

| AlphaGo Zero(人間の棋譜データなしに自己対戦だけで学習したAlphaGoの発展版) |

| エドワード・ファイゲンバウム(知識工学の提唱者・DENDRALの開発者) |

次のステップ

第1章・第2章で「AIはどこから来たのか」という Part 1 の学習が完了しました。次は Part 1 まとめとして、第1章と第2章の対応関係を一枚の表に整理します。試験直前の復習や、黒本との照合にも使いやすいコンテンツです。

その後、Part 2「AIはどうやって学ぶのか」へ。第3章の機械学習の具体的手法に進みます。